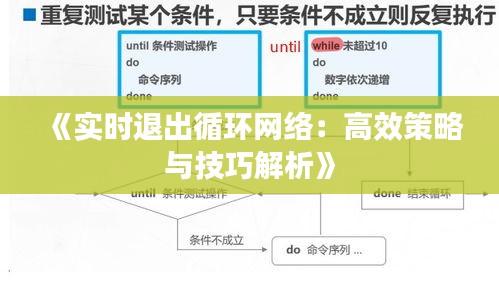

标题:《实时退出循环网络:高效策略与技巧解析》

随着信息技术的飞速发展,循环网络在各个领域得到了广泛应用。然而,在实际应用中,如何实时退出循环网络,以确保系统的高效稳定运行,成为了一个亟待解决的问题。本文将针对这一问题,从理论到实践,详细解析实时退出循环网络的策略与技巧。

一、循环网络概述

循环网络(Recurrent Neural Network,RNN)是一种能够处理序列数据的神经网络,具有记忆能力,在自然语言处理、语音识别、时间序列分析等领域具有广泛的应用。然而,传统的循环网络在训练过程中容易出现梯度消失或梯度爆炸等问题,导致训练效果不佳。

二、实时退出循环网络的策略

- 设置退出条件

在循环网络中,设置合理的退出条件是实时退出循环的关键。以下是一些常见的退出条件:

(1)达到预设的迭代次数:在训练过程中,设定一个最大迭代次数,当达到该次数时,自动退出循环。

(2)达到预设的准确率:当模型在验证集上的准确率达到预设值时,停止训练,退出循环。

(3)模型性能不再提升:当模型在验证集上的性能不再提升,甚至出现下降趋势时,退出循环。

- 动态调整学习率

在训练过程中,动态调整学习率可以有效地防止梯度消失或梯度爆炸,提高模型的训练效果。以下是一些常见的动态调整学习率的方法:

(1)学习率衰减:随着迭代次数的增加,逐渐减小学习率,防止模型在训练过程中出现过拟合。

(2)自适应学习率调整:采用Adam、RMSprop等自适应学习率调整算法,根据模型在训练过程中的表现自动调整学习率。

- 使用正则化技术

正则化技术可以有效地防止模型过拟合,提高模型的泛化能力。以下是一些常见的正则化技术:

(1)L1正则化:在损失函数中加入L1范数,惩罚模型中权重较大的参数。

(2)L2正则化:在损失函数中加入L2范数,惩罚模型中权重较大的参数。

三、实时退出循环网络的实践技巧

- 优化代码结构

在实现循环网络时,优化代码结构可以提高代码的可读性和可维护性,从而提高开发效率。以下是一些优化代码结构的技巧:

(1)使用函数封装:将循环网络中的重复代码封装成函数,提高代码复用性。

(2)模块化设计:将循环网络分解为多个模块,降低代码复杂度。

- 使用可视化工具

使用可视化工具可以直观地观察模型在训练过程中的表现,及时发现并解决潜在问题。以下是一些常用的可视化工具:

(1)TensorBoard:TensorFlow官方提供的可视化工具,可以实时查看模型训练过程中的各种指标。

(2)PyTorch TensorBoard:PyTorch官方提供的可视化工具,与TensorBoard功能类似。

四、总结

实时退出循环网络是提高循环网络训练效率的关键。本文从理论到实践,详细解析了实时退出循环网络的策略与技巧,包括设置退出条件、动态调整学习率、使用正则化技术、优化代码结构以及使用可视化工具等。希望本文能为读者在实际应用中解决实时退出循环网络问题提供参考。

转载请注明来自衡水悦翔科技有限公司,本文标题:《《实时退出循环网络:高效策略与技巧解析》》

冀ICP备2023036310号-1

冀ICP备2023036310号-1